Starnberg, Herzlia/Tel Aviv (Israel), 25. Jan. 2018 - Software Definierter Speicher der anderen Art; das Storage Consortium zu Besuch bei Infinidat in Israel...

Zum Hintergrund: gerade konzentrieren sich RZ Infrastruktur-Verantwortliche im Zusammenhang mit Storage- und Data Management auf drei strategische Bereiche: 1. Scale-out NAS (clustered Filesysteme) und Object Storage für unstrukturierte Daten; 2. Cloud (private-, hybrid-/multi-cloud) Deployments; 3. Virtual Enterprise (Block-/unified) Storage (mehr strukturierte Daten / Unified Workload-Konsolidierung). Das verwundert nicht, denn auf Grund des starken Datenwachstums und neuer Anwendungen (1) sind aus Infrastruktursicht flexibler skalierbare Lösungen gefordert, die neben Leistung und Hochverfügbarkeit auf der Beschaffungsseite flexibel und damit attraktiv sind. Aber unabhängig, ob on-premise im eigenen RZ oder als Provider eines Cloud Datacenter: Skalierbarkeit und einfache Verwaltung, günstige Speicherkosten (CAPEX / OPEX), hohe E/A-Performance, eine effektive Cloud-Anbindung sowie „Always-on“ Betrieb werden zunehmend zentrale Randbedingungen für Unternehmensspeicher.

Wir wollen uns im Folgenden mit Enterprise (Block / File) Storagelösungen für virtuelle Umgebungen beschäftigen und waren zu diesem Zweck auf Einladung von Moshe Yanai, CEO & Gründer von Infinidat - einem auf „Big Enterprise-Storage“ spezialisierten Anbieter - im letzten Monat zu Besuch in Herzlia / Tel Aviv, Israel. Hier unser kurzer Bericht zur „InfiniBox“ Storagelösung nebst Architekturansatz des noch relativ jungen Anbieters auf Grundlage der Gespräche vor-Ort mit dem Infinidat-Team (Anmerkung: Moshe Yanai gilt u.a. als Vater der EMC Symmetrix und gründete danach die Firma XIV (Storage Array), die neben Diligent an IBM verkauft wurde).

Das Unternehmen Infinidat wurde 2011 gegründet und begann im Jahr 2014 mit dem Verkauf seiner InfiniBox in USA. Zu den ersten Anwendern zählten einige der weltweit größten Telekommunikationsanbieter, Banken sowie Cloud Service Provider, die das System einsetzen um eine große Anzahl von Legacy-Systemen auf einer Speicherplattform zu konsolidieren. Inzwischen hat Infinidat nach eigenen Angaben weltweit bereits mehrere hundert Unternehmenskunden mit über zwei Exabyte an Kapazität, wächst überdurchschnittlich schnell und ist solide finanziert (3). Bevorzugte Use Cases der Lösung sind Mission-critical Enterprise Apps, Petabyte Scale-Clouds, Next Gen Analytics und Secure Archives.

Grundsätzlich ist man bei Infinidat der Meinung, dass die gestiegenen Anforderungen an die Unternehmens-IT eine neue Storage-Architektur notwendig machen, die sich grundlegend von den verbraucher-zentrierten Cloud-Storage-Plattformen des letzten Jahrzehnts sowie allen bisherigen Enterprise-Storage-Systemen unterscheidet.

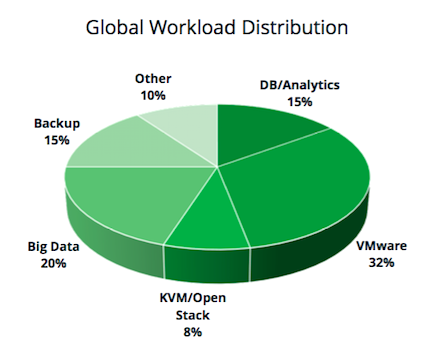

Abb.1: Infinibox Use Cases (Quelle: Infinidat, 2017)

Was unterscheidet die Lösung von anderen Systemen?

InfiniBox nutzt mit Hyper-Storage einen patentierten Software-Ansatz, der maschinelle Lern-Algorithmen einsetzt, sowohl um hohe Performance, aber auch höchste Zuverlässigkeit auf Basis von preiswerten Standard x86 Server und HDDs zu erreichen. Dazu nutzt das System den gleichen SATA-Festplattentyp mit hoher Kapazität, der typischerweise auch von Google, Facebook & Co. verwendet wird. Flash und DRAM werden aus Kostengründen derzeit nur im Cache eingesetzt. Auf Basis der verwendeten Software-/Hardware-Architektur ist es nach Angaben der Entwickler dabei gelungen, trotz eines Festplatten-Anteils von ca. 95% in der Box mit der I/O-Leistung von All-Flash-Systemen zu konkurrieren bzw. diese in einzelnen Anwendungsfällen sogar zu übertreffen (>> Writes). InfiniBox-Systeme können derzeit rund fünf Petabyte pro System verwalten. Die gemessenen Latenzzeiten liegen dabei im Sub-Millisekunden-Bereich und eine System-Zuverlässigkeit von 99,99999 Prozent wird auch bei hyperskalierenden Kapazitätsgrößen erreicht.

Die Speicherarchitektur "Hyper-Storage"

Hyper-Storage als Software-Ansatz wurde entwickelt, um diverse hardwarebedingte Einschränkungen (z.B. den Ausfall von Festplatten) aufzuheben und ist somit das Gegenteil einer hardware-zentrierten Architektur, die meist versucht, softwarebedingte Einschränkungen zu umgehen. Das Konzept beruht aber nach Infinidats’ Moshe Rivel - Senior Director of Tech Sales - vor allem auf Intelligenz im Design, um neben den Designvorteilen auch wettbewerbsfähige Preise zu erreichen. Mr. Rivel während unseres Gesprächs (Zitatauszug): „Infinibox ist auch das Ergebnis der optimierten parallelen Verwendung vorhandener Elemente statt unnötiger und teurer Hardware; dazu kommen maschinelles Lernen, Data Analytics statt Try & Error beim Kunden sowie die konsequente Nutzung der Vorteile aller einzelnen Komponenten unter Vermeidung ihrer jeweiligen Schwachstellen.“

Grundsätzlich wird nach Aussage der Verantwortlichen jede einzelne I/O-Operation im Gesamtsystem beobachtet, dokumentiert, analysiert und im Detail ausgewertet, um die weiteren E-/A-Operationen dann kontinuierlich weiter verbessern zu können. Die erste Stufe dieses Ansatzes ist es, einen automatisierten Mechanismus in jedes System zu integrieren, um die damit ausgeführten Workload-Muster zu erlernen und den Service kontinuierlich über die Zeit zu verbessern.

Die zweite Stufe besteht darin, diese Muster aus allen weltweiten Systemen zu übernehmen, sie zu kombinieren und weiter aus ihnen zu lernen, sprich zu optimieren. Damit lassen sich die Algorithmen für maschinelles Lernen konstant verbessern. Beispiel: Messen und Analysieren erfolgreicher oder erfolgloser Cache-Hits; Verbesserung von Prefetch-Mechanismen durch Neuorganisation der Daten zur Zugriffseffektivität – diese und viele andere erlernbare I/O-Muster werden zu Optimierungen genutzt. Durch den gezielten Einsatz dieser Pattern und Verwendung der dafür jeweils optimierten Data-/Storage-Services lassen sich verschiedenste I/O-Muster unabhängig von ihrem Einsatzort im selben System abdecken. Viele unterschiedliche Application-Workloads sollen so gemeinsam auf einer Plattform eingesetzt und bedient werden können.

Abb. 2: Das Foto zeigt Moshe Rivel, Senior Director of Tech Sales EMEA & APJ Infinidat, vor Unternehmenspatenten im zentralen Besprechungsraum (Bildquelle: Storage Consortium, Dez. 2017).

Hyper-Storage versus RAID

Klassische RAID-Gruppen sind auf Grund der gestiegen Anforderungen (Verfügbarkeit, Datenmengen, Leistung) zunehmend problematisch, denn sie erzeugen eine direkte Kopplung von Software und Hardware (Silo-Ansatz), die wenig flexibel ist. Bei jedem Laufwerks-Ausfall sind lange Restore-Prozesse notwendig, die negative Auswirkungen auf die Performance und Verfügbarkeit haben können. Die Kopplung logischer Einheiten wie LUNs mit Filesystemen und den daran beteiligten Hardwarekomponenten bedeuten weitere Einschränkungen. Infinidat Hyper-Storage verwendet n-logische Schutzgruppen auf Blockebene, die vollständig von der Hardware entkoppelt sind. Dies führt nach Angaben der Entwickler zu leistungsfähigeren Prozessen, die sich parallel auf allen Komponenten gleichzeitig ausführen lassen (Auto-balanced).

Redundante Systemauslegung

Hyper-Storage bildet für jede einzelne Komponente immer eine mehrfache Redundanz. Damit bleibt das System auch beim Ausfall mehrerer Komponenten vollständig redundant (N+2 im gesamten Datenpfad und im gesamten Stromversorgungsbereich). Ein höherer Schutz wurde jedoch für die Plattenlaufwerke selbst implementiert: Durch die Entkopplung der Software von der Hardware durch Virtualisierung und unter Verwendung von virtuellen Reservekapazitäten anstelle physischer Reservelaufwerke (wie z.B. bei RAID-6) können in den Systemen sogar Dutzende von beliebigen Laufwerken ausfallen, bevor es erforderlich wird, diese zu ersetzen. Beim Ausfall von Drives wird automatisch ein Selbstheilungs-Prozess unter Verwendung aller aktiven Laufwerke angestoßen. Nach wenigen Minuten sollen die Daten auf allen aktiven Laufwerken komplett bei vollem Paritätsschutz wieder rekonstruiert sein.

Beim Schreiben von Multi-PByted treten logische Datenfehler auch unter Verwendung von CRC (cyclic redundancy check) auf. Hyper-Storage nimmt laut Entwickler für sich in Anspruch, diese Fehler im laufenden Betrieb transparent zu korrigieren und zwar ohne dass Anwender davon etwas mitbekommen.

Betriebsabläufe mittels Virtualisierung und Automatisierung vereinfachen

Das Hyper-Storage-Frontend ist nur virtuell abgebildet, d.h. es wird kein physischer Block formatiert oder einem bereitgestellten-/exportierten Adressraum fest zugeordnet. Der für den Nutzer sichtbare Bereich ist ein schlanker Adressraum der mittels Virtualisierung von der Hardwareschicht getrennt ist; dieser virtuelle Raum kann bis zu 1.000 mal größer als der physische Raum sein. Weiterer Vorteil: jedes Erstellen, Löschen und Ändern einer Einheit wird sofort durchgeführt, wobei nur Pointer zwischen den Virtualisierungs-Ebenen erzeugt und neu ausgerichtet werden.

Gleiches gilt für Datenkopien / Snapshots: Es lassen sich quasi unendlich viele Kopien mit sofortiger Wirkung inklusive der benötigten Aufbewahrungsvorschriften (Retention Policies) erstellen, löschen, klonen, zuweisen, aktualisieren und wiederherstellen. Durch die Verwaltung der Virtualisierungs-Ebenen aus dem DRAM werden Operationen mit Latenzzeiten im Mikrosekundenbereich durchgeführt – ohne Auswirkung auf die vom System auszuführenden I/O-Requests. Dies in Kombination mit weiteren Automatisierungsprozessen zur Optimierung der Speicherverwaltung sind nach Angaben des Herstellers für die hohe Bedienungsfreundlichkeit zuständig; dies soll bis in den Exabyte-Bereich hinein gelten.

Abb. 3: Infinibox Shelf mit jeweils 60 Festplatten (Bildquelle: Storage Consortium / Infinidat)

Infinidat Infinibox ist als sog. Mesh-Architektur aufgebaut (2): Die Lösung verwendet drei Knoten (N=3) pro Rack; die Nodes repräsentieren die Intelligenz im System. Jeder unabhängige Knoten enthält dazu einen Industrie-Standard Server sowie DRAM plus Flash als Cache (derzeit als Flash Cache bis 200TB und RAM bis zu 3TB). Kommentar von Moshe Yanai: „Das System ist intern dreifach redundant ausgelegt und für unternehmenskritische Anwendungen hin entwickelt. Nur rund 3 - 5 Prozent im System bestehen aus Flash während rund 95% der Kapazität mit near-line SATA Drives (SAS-Interface) arbeiten. Damit sind wir in der Lage, preislich im Petabyte-Bereich sehr konkurrenzfähig aufzutreten.“ Aufgrund der kombinierten Hardware-Software Architektur (von Random-I/O zu Sequential Access mit Hilfe von intelligenten Algorithmen) soll die Leistungsfähigkeit von Flash-only erreicht werden - jedoch zum halben Preis von All Flash Systemen (CAPEX).

Das aktuelle InfiniBox Release R4 führt nach Herstellerangaben eine optimierte Implementierung von synchroner Replikation mit sehr niedrigen Latenzen ein: InfiniBox Synchronous Replication erzeugt laut Entwickler weniger als 400 µs Latenz, soll sich dabei einfach einrichten lassen und kein weiteres Management benötigen; auch sind Cache-basierende Quality-of-Service (QoS) Funktionen verfügbar, um Tiering zu umgehen (Performance-Impact).

Asynchrone NAS-Replikation / TreeQs

Asynchrone Replication for NAS teilt sich eine gemeinsame Funktionalität mit dem SAN bei 4,0 sec. Recovery Point Objective (RPO); die Funktion unterstützt laut Entwickler die Replikation von Cloud-fähigen Filesystemen mit Milliarden von Dateien pro Dateisystem ohne Latenzzeiten. Eine granulare Kontrolle über das Filesystem ist möglich, so dass Anwender ihre User-Quotas auf Verzeichnisebene erstellen können, wodurch die Migration von älteren NAS Systemen vereinfacht wird. Die Lösung soll dabei laut Hersteller auf Millionen von Quotas ohne Performance-Einbußen und bei der Auslastung skalieren.

Ein Fazit: Auf Grund der Kombination von Software zusammen mit einer durchgetesteten, qualifizierten (internen Server-) Hardware-Referenzplattform bildet Hyper-Storage unter Verwendung von Standard Komponenten eine hochintegrierte softwaredefinierte Enterprise Speicherplattform, die sich zur kosteneffektiven Konsolidierung verschiedenster Workloads für große Umgebungen bereits ab 200 TB anbietet. Warum der Begriff "Software Defined" in diesem Zusammenhang? Weil prinzipiell die Software ähnlich anderen Anbieterlösungen auch separat auf Industrie-Standard-Konfigurationen lauffähig sein würde. Nur gibt es für den Hersteller derzeit gute Gründe dagegen, denn nur auf Grund der hochgradigen Integration & Tests aller Systemkomponenten lassen sich die angegebenen Verfügbarkeits- und Leistungswerte dauerhaft erreichen; die Anwendungsgebiete von Big Enterprise Storage wie transaktionsorientierte Umgebungen tolerieren Systemausfälle nicht.

Quellen

(1) IoT Drives Realtime Data (Quelle: IDC White Paper © 2017. IDC Data Age 2025: The Evolution of Data to Life-Critical Don’t Focus on Big Data; Focus on the Data Thats Big. Sponsored by Seagate. David Reines, John Ganz, John Rydning, April 2017

(2) Quelle: Infinidat Storage Architecture, Whitepaper, WP-STORARC-161007-A4, 2016

(3) Querverweis: Unser Beitrag > Infinidat erhält 95 Millionen US-Dollar in neuer Serie-C-Finanzierungsrunde... Goldman Sachs Private Capital Investing leitet Investitionsrunde mit anhaltender Beteiligung von TPG Growth.

Bild 3: Impression vom Besuch des Storage Consortium bei Inifinidat (von rechts nach links): Moshe Rivel, Senior Director Tech Sales Infinidat / Moshe Yanai, CEO & Founder von Infinidat im Gespräch mit Norbert Deuschle, Gründer Storage Consortium / weitere technical team member Infinidat (Bildquelle: Infinidat für Storage Consortium, Dez. 2017)