Böblingen, Starnberg, 02. April 2024 - KI-Suchfunktionen für die Netzwerk-Management-Plattform. Das Ziel: Antwortzeiten, Richtigkeit, Genauigkeit und Datenschutz optimieren...

Zur Ankündigung: KI ist im Netzwerkbetrieb zwar bereits länger im Einsatz, kann jedoch mit den neuen Modellen mit natürlicher Sprache benutzt werden, was spezifische Herausforderungen mit sich bringt, um damit auch sinnvolle Ergebnisse für den Praxisbetrieb zu erreichen. Hewlett Packard Enterprise hat generative KI in seine Netzwerk-Management-Plattform HPE Aruba Networking Central integriert, insbesondere um die Nutzererfahrung / Arbeitseffizienz von Netzwerk-Administratoren verbessern zu helfen. Der Generative-KI-Ansatz von HPE Aruba Networking Central unterscheidet sich laut dem Unternehmen dabei stark von Angeboten, die nur eine Schnittstelle zu öffentlich zugänglichen Large Language Models (LLM) anbieten. (1)

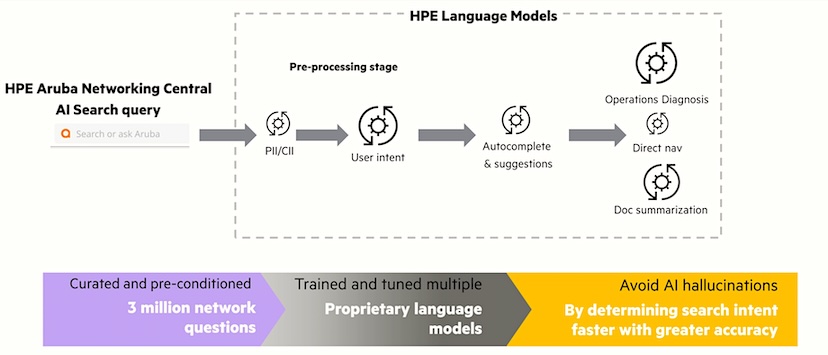

HPE Aruba Networking hat mehrere vorhandene LLMs speziell für seine Zwecke abgestimmt und abgeschottet mit dem Ziel, Antwortzeiten, Richtigkeit, Genauigkeit und Datenschutz zu optimieren. Die LLMs laufen als proprietäre Versionen in einer Sandbox auf HPE Aruba Networking Central. Kunden- und personenbezogene Informationen (PII/CII) werden laut Anbieter entfernt.

Seit ihrer Einführung im Jahr 2014 verfügt die Plattform HPE Aruba Networking Central über Werkzeuge für die Konfiguration, Verwaltung, Überwachung und Fehlerbehebung von Netzwerken (kabelgebundene und drahtlose LAN, WAN und IoT-Umgebungen). Das SaaS-Angebot wird als Jahresabonnement mit einem zweistufigen Lizenzierungsmodell (Foundation und Advanced) verkauft. HPE Aruba Networking Central ist ferner als Teil von HPE GreenLake for Networking (NaaS) erhältlich. Die neue, auf generativer KI basierende KI-Suchfunktion soll laut Anbieter im zweiten Quartal des Geschäftsjahres '24 verfügbar und dann in allen Lizenzen enthalten sein.

Bildquelle: HPE Aruba Networking Central

Über ein spezifisches Data Lake hat HPE Aruba Networking nach eigenen Angaben inzwischen Telemetriedaten von fast vier Millionen Netzkomponenten und mehr als einer Milliarde vernetzter Geräte gesammelt, die die maschinellen Lernmodelle von HPE Aruba Networking Central für vorausschauende Analysen und Empfehlungen unterstützen.

Die Trainingsdatensätze hinter den Generative-KI-Funktionen von HPE Aruba Networking Central sollen dabei bis zu zehnmal größer als die anderer Cloud-basierter Plattformen sein. Sie umfassen mehr als drei Millionen Fragen, die über viele Jahre hinweg von Kunden erfasst wurden sowie Zehntausende öffentliche Dokumente.

(1) Quelle / Link > Blogbeitrag mit Anwendungsbeispielen der neuen generativen KI finden Sie beim Hersteller unter diesem externen Link > https://blogs.arubanetworks.com/solutions/welcome-genai-to-hpe-aruba-networking-central

Querverweis:

Unser Beitrag > Sicherheitslücken in der IT-Infrastruktur finden: Neue Horizon3.ai Services für PCI DSS v4.0

Unser Beitrag > Kubermatic KubeLB Lösung zur Bereitstellung von Anwendungen in Cloud-nativen Umgebungen

Unser Blogpost > Speicheranforderungen bei KI-Anwendungen: Randbedingungen und Einsatzkriterien