Fortschritt für die RAG-Suche: 4,8 Milliarden hochdimensionale Vektorsuchen auf einem Server. cuVS-Bibliothek von NVIDIA in Verbindung mit open-source AiSAQ Technologie für ANNS beschleunigt die Indexerstellung durch GPUs…

Hintergrund

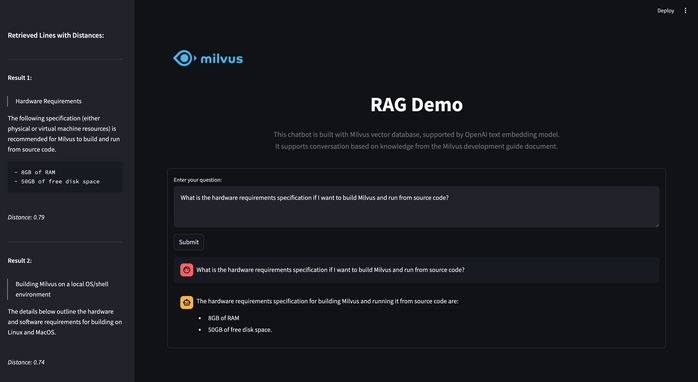

Die zentrale Komponente von RAG ist eine Vektordatenbank, die spezifische Daten zusammenführt und deren Eigenschaften in Vektoren innerhalb der Datenbank umwandelt. Die Indexerstellung in großen Vektordatenbanken stellt aktuell jedoch einen zentralen Engpass dar.

In Zusammenarbeit mit NVIDIA konnte KIOXIA nach vorliegenden Angaben jetzt eine bis zu 20-fache Verbesserung der Indexierungszeiten bei Verwendung der AiSAQ-Technologie für hochdimensionale Vektoren mit 1.024 Dimensionen erzielen und die „Ende-zu-Ende Build-Zeiten“ um das bis zu 7,8-Fache reduzieren Konkret bedeutet das laut Entwickler eine Reduktion von 28,4 Tagen auf 1,4 Tage für die Indexerstellung mit vier NVIDIA Hopper GPUs. (1)

Weiterer technische Details zur Ankündigung

Um hochdimensionale Vektorsuchen mit 4,8 Milliarden Vektoren auf einem einzigen Server zu skalieren, kam für den Test die Open-Source-Technologie KIOXIA AiSAQ für Approximate Nearest Neighbor Search (ANNS) zum Einsatz. Darüber hinaus konnte das Unternehmen durch GPU-Beschleunigung mit Hilfe der cuVS-Bibliothek von NVIDIA die Zeiten für die Indexerstellung signifikant verkürzen.

Diese beiden Ergebnisse stellen einen wichtigen Fortschritt für RAG (Retrieval Augmented Generation)-Suchlösungen dar. Die weitere Entwicklung zielt laut Entwickler darauf ab, auch größere Deployments jenseits von 4,8 Milliarden Vektoren - wie künftig sogar Billionen-Vektor-Deployments - zu erreichen.

Die Reduktion von 28,4 Tagen auf 1,4 Tage für die Indexerstellung mit vier NVIDIA Hopper GPUs und eine Verringerung der Gesamtdauer von 31 auf 4 Tage hat für KI-Anwendungen folgenden Vorteil: Die Applikationen können auf größere Mengen vektorisierter Informationen zugreifen, die auf SSDs gespeichert sind und mehrere zehn Milliarden Vektoren umfassen, da DRAM allein im Milliardenbereich unpraktikabel wird.

KIOXIA AiSAQ ermöglicht laut diesen Informationen somit hoch-skalierbare Speicherarchitekturen, die Milliarden von Suchvorgängen unterstützen können, steigende Latenzanforderungen von RAG-Anwendungen erfüllen und durch GPU-beschleunigte Indexerstellung auf einem einzigen Server auch große Bereitstellungen realisierbar machen, so wie etwa innerhalb einer (open source-) Milvus-VektorDB-Umgebung.

Bildquelle: Milvus VektorDB. Externer Link > https://milvus.io/de

AiSAQ: Quelloffene Skalierung für RAG

Vorgestellt in 2025, adressiert die Open-Source-Software KIOXIA AiSAQ Skalierungsherausforderungen bei RAG-Anwendungen, indem Vektorsuchen direkt von SSDs durchgeführt werden und damit der DRAM-Bedarf reduziert wird.

Die Technologie bietet laut Entwickler hohe Skalierbarkeit, soll sich für Multi-Tenant-Umgebungen ebenso eignen, wie für monolithische Index-Deployments im großen Maßstab.

KIOXIA AiSAQ nutzt hier einen neuen Global-Index-Algorithmus, der hybride Cluster-Bildung und Graph-Suche kombiniert, um effiziente Vektorsuchen im Extrem-Maßstab zu erreichen.

Mit Anpassungsoptionen zur Balance zwischen Leistung und Skalierbarkeit großer Vektor-Volumina kann die Software hochskalierte Deployments leichter zugänglich machen und einfacher erweitern.

Querverweis mit weiteren Fachinformationen und PDF Link, siehe Research Paper „AiSAQ All-in-Storage ANNS with Product Quantization for DRAM-free Information Retrieval“ (Graph-based approximate nearest neighbor search) > https://arxiv.org/abs/2404.06004

Kommentar Jason Hardy, Vice President, Storage Technologies bei NVIDIA: „Vektordatenbanken bilden das Rückgrat für KI-Anwendungen, die Intention, Kontext und Ähnlichkeit in riesigen, unstrukturierten Datensätzen in Echtzeit erkennen müssen. Durch die Nutzung GPU-beschleunigter Indexierung mit der cuVS-Bibliothek von NVIDIA unterstützt KIOXIA hochdimensionale Vektordatenbanken, die sowohl skalierbar als auch effizient in der Indexerstellung sind.“

KIOXIA's AiSAQ Open-Source-Software finden Sie unter diesem externen Link zum Download > https://github.com/kioxia-jp/aisaq-diskann

(1) Quelle: "Insgesamt wurden laut KIOXIA 19,66 TB an Vektordaten für diesen Benchmark verarbeitet. Hinweis: Die Performance- bzw. Benchmark-Ergebnisse können je nach Host Device, Lese- und Schreibkonditionen, Datengrößen und anderen Faktoren variieren."

Querverweis:

Unser Blogpost > Blog: Datenintensive KI-Applikationen und steigende Anforderungen an die Speicherinfrastruktur

Unser Blogpost > KI-Storage-Herausforderungen: Wie kann Speicherplatz im KV-Cache beim Einsatz großer Sprachmodelle und der Vektorsuche optimiert werden?

Unser Beitrag > Infinidat präsentiert neue Architektur für Retrieval-Augmented-Generation (RAG) Workflow-Deployments