Governance und vorhersehbare Performance innerhalb einer gemeinsamen und anbieterneutralen Architektur. Verteilte KI im Unternehmensmaßstab sicher skalieren...

Hintergrund

Die meisten Infrastrukturen von Unternehmen sind derzeit noch nicht per se für die Komplexität einer verteilten KI (Distributed AI) ausgelegt. Laut Mary Johnston Turner, Research Vice President für Digital Infrastructure Strategies bei IDC, gehen die Marktforscher allerdings davon aus, "dass 80% der Unternehmen bis 2027 eine verteilte Edge-Infrastruktur einsetzen werden, um die Latenz und Reaktionsfähigkeit von KI-Anwendungen zu verbessern".

Ankündigungsübersicht

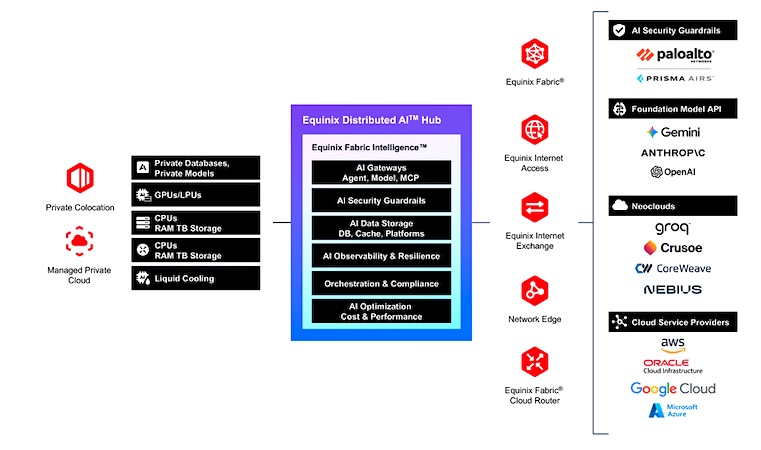

Equinix hat dazu am 11. März 2026 seinen „Distributed AI Hub“ vorgestellt. Dieser wird durch Equinix Fabric Intelligence™ unterstützt und soll Unternehmen einen einheitlichen Rahmen für die Verbindung zunehmend komplexer und verteilter KI-Ökosysteme bieten, diese sichern und auch vereinfachen.

Der Hub ist im Prinzip ein neutraler Standort, an dem Unternehmen KI-Infrastrukturanbieter wie Modellunternehmen, GPU-Clouds, Datenplattformen, Netzwerk- und Sicherheitsdienste sowie AI-Frameworks über private, latenzarme Verbindungen finden können. Möglich wird dies laut Anbieter in den 280 Hochleistungsrechenzentren von Equinix, wo Unternehmen mit diesen Anbietern auch direkt in Verbindung treten und ihre Dienste nutzen können.

"KI ist von Natur aus nicht zentral"

Um das volle Potenzial autonom handelnder KI auszuschöpfen, sollten Unternehmen laut Equinix deshalb ihre von Natur aus verteilten Workflows harmonisieren.

„Trainingsdaten und Inferenz-Workloads sind über öffentliche Clouds, private Rechenzentren, Edge-Umgebungen und eine wachsende Zahl spezialisierter Neoclouds verteilt. Diese weisen jeweils ganz spezifische Leistungs- und Souveränitätsbeschränkungen auf. Folglich kann dies Innovationen verlangsamen und die Steuerung erschweren.

Dieses Geflecht aus isolierten Systemen kann Innovation ausbremsen, die Governance erschweren und es nahezu unmöglich machen, KI‑Workloads dort auszuführen, wo die zugrunde liegenden Daten entstehen – was den geschäftlichen Nutzen begrenzt und die Nutzererfahrung beeinträchtigt.“

Anbieter-neutrale Umgebung

Der Distributed AI Hub als zentrale Plattform, die Daten, Rechenleistung, Cloud-Plattformen und KI-Partner in einer offenen und Anbieter-neutrale Umgebung zusammenführt, ist laut Equinix im Gegensatz zu KI-Marktplätzen von Hyperscalern (die ihre eigenen Dienste bevorzugen) von Grund auf offen und herstellerneutral konzipiert.

Unternehmen können ihre KI-Workloads dort ausführen, wo sie die besten Ergebnisse erzielen, ohne ihre Architektur jedes Mal neu aufzubauen oder Daten an verschiedene Standorte verschieben zu müssen. Dadurch erhalten Kunden die Freiheit, ihren eigenen AI‑Stack aus den jeweils besten Lösungen am Markt zusammenzustellen.

Abb.: Equinix Distributed AI Hub (Bildquelle: Equinix).

Mit Einführung des Distributed AI Hub wird die Möglichkeit geboten, KI an verschiedenen Standorten so einzusetzen, als wäre sie zentralisiert. Nach Equinix können Unternehmen mit dem neuen Angebot ihre KI dort entwickeln und skalieren, wo bereits die Daten, Partner und Teams angesiedelt sind. Gleichzeitig sollen Inferenzprozesse in der Nähe der benötigten Daten und Nutzer stattfinden können, ohne den operativen Aufwand, der durch die Fragmentierung komplexer Systeme entsteht.

Integration des Distributed AI Hub mit Palo Alto Networks

Die Zusammenführung zum Echtzeitschutz ermöglicht Interaktionen zwischen KI-Agenten und externen Tools oder Datenquellen. Eine Kombination der globalen, verteilten KI-Infrastruktur von Equinix mit der Prisma AIRS™-Technologie von Palo Alto Networks bietet dazu Echtzeit-KI-Security mit zentralisierter Kontrolle von Richtlinien.

Hiermit adressiert die Lösung eine standortunabhängige umfassende Sichtbarkeit und Kontrolle über KI-Anwendungen, Daten und Interaktionen. Zusätzlich wird laut Anbieter Prisma AIRS über Equinix Network Edge verfügbar sein. Unternehmen können dann KI-gesteuerte Sicherheitsdienste näher an Nutzer, Clouds und kritischen Workloads zentral verwalten.

Anwenderkommentar Lloyd Taylor, CTO/CISO bei Alembic: „Die Diskussion rund um Distributed AI wird endlich konkret. Es geht um weit mehr als nur Rechenleistung und Daten, es geht darum zu kontrollieren, wo die Daten gespeichert werden und wie die Rechenprozesse ablaufen. Equinix hat das Problem richtig erkannt: Mit dem Distributed AI Hub vereinen sie Platzierung, Governance und vorhersehbare Performance in einer gemeinsamen Architektur. Genau das macht Distributed AI im Unternehmensmaßstab überhaupt erst realisierbar.”

Hinweis: Equinix wird auf der NVIDIA GTC (Stand 1030) vertreten sein und dort seinen Hub vorstellen.

Querverweis:

Unser Beitrag > KI-Automatisierung in der Multi-Cloud: Equinix stellt Distributed AI Infrastructure vor

Unser Beitrag > Integrierte Software-Plattform für KI-Fabriken auf Basis von Red Hat AI Factory with NVIDIA

Unser Beitrag > Digitale Souveränität quo vadis?