Neue KI-Funktionen der Voyage AI 4-Series, um die Distanz zwischen KI-Prototyping und Live-Betrieb zu verringern. Eine einheitliche intelligente Datenschicht, um das Potenzial von KI-Anwendungen auszuschöpfen…

Ankündigungsübersicht

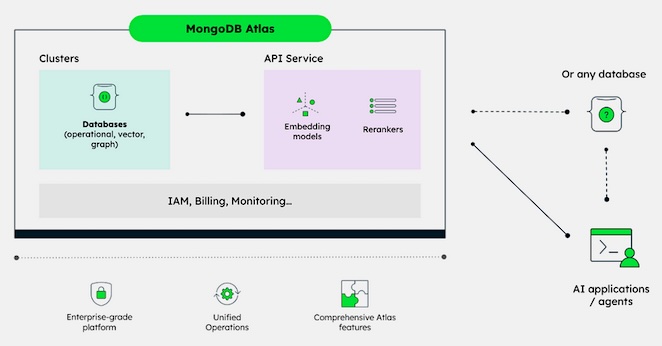

MongoDB hat die Erweiterungen seines KI-Angebots bekanntgegeben. (1) Dazu werden die Kerndatenbank des Unternehmens mit den Embedding- und Re-ranking-Modellen von Voyage AI zusammengeführt, um eine einheitliche „Datenintelligenz-Schicht“ für betriebsbereite KI bereitzustellen.

Durch eine direkte Integration dieser Modelle in die Plattforminfrastruktur von MongoDB sollen Entwickler anspruchsvolle Anwendungen in großem Maßstab mit minimiertem Risiko von KI-Halluzinationen erstellen und betreiben können – dies ohne Daten zu verschieben oder zu duplizieren.

Hintergrund

Um Entwickler bei der Einführung von KI-Anwendungen in den Live-Betrieb zu unterstützen, hat MongoDB eine Reihe neuer KI-Funktionen eingeführt, die Entwicklung und Betrieb intelligenter Anwendungen vereinfachen. Das Unternehmen stellt dazu fünf Embedding-Modelle aus Voyage AI - der Embedding- und Retrievel-Suite von MongoDB - vor:

Auto-Embedding für die MongoDB Community Vector Search, Embedding- und Reranking-Modell-APIs in Atlas sowie einen KI-gestützten Datenoperationsassistenten für MongoDB Compass und Atlas Data Explorer. Die Voyage AI-Modelle sind in die Datenbankdienste von MongoDB integriert, können aber laut Entwickler auch weiterhin unabhängig voneinander verwendet werden.

Ankündigungsdetails

Wenn Projekte live gehen, stellen viele Unternehmen fest, dass ihre bestehenden Datenbestände nicht dafür ausgelegt sind, kontextbezogene, abrufintensive Workloads in großem Maßstab zu unterstützen. Entwickler müssen sich mit fragmentierten Kombinationen aus operativen Datenbanken, Vektorspeichern und Modell-APIs auseinandersetzen, was zu Komplexität, Latenz und Betriebsrisiken führt – und dies genau dann, wenn Geschwindigkeit und Zuverlässigkeit besonders wichtig sind.

Fragmentierung ist zu einem Haupthindernis für KI-Innovationen geworden, was reale Auswirkungen auf die Kunden hat. MongoDB adressiert dieses Problem, indem es die Kernfunktionen, die für die Entwicklung und den Betrieb von KI-Anwendungen in der Produktion erforderlich sind, in einer Datenplattform zusammenfasst.

Anstatt eine operative Datenbank, einen Vektorspeicher und mehrere Pipelines miteinander zu verbinden, können operative Daten und Abruffunktionen zusammengehalten werden, wodurch sich Latenzzeiten und Synchronisationsaufwendungen reduzieren. Im Ergebnis sollten dann eine einfachere Architektur, schnellere Iterationen und KI-Anwendungen stehen, die so konzipiert sind, dass sie nicht nur in Demos, sondern auch im realen Einsatz zuverlässig laufen.

Abb.: MongoDB Atlas for AI retrieval (Bildquelle: MongoDB, Introducing the Embedding and Reranking API on MongoDB Atlas).

Kommentarauszug Fred Roma, Senior Vice President of Product and Engineering bei MongoDB: „Entwickler wünschen sich weniger bewegliche Teile und klarere Wege vom Prototyp bis zum Live-Betrieb. Mit den neuen Funktionen hilft MongoDB Entwicklerteams dabei, die Komplexität zu reduzieren und sich auf die Entwicklung von KI-Anwendungen zu konzentrieren, die in realen, unternehmenskritischen Umgebungen funktionieren.“

Zu den neuen Funktionen gehören (Quelle, Anbieter):

„State-of-the-Art-Genauigkeit mit Modellen der Voyage AI 4-Series: Embedding-Modelle für eine exakte Suche zu geringeren Kosten. Die Serie umfasst das universell einsetzbare Embedding-Modell „voyage-4“, das ein Gleichgewicht zwischen Suchgenauigkeit, Kosten und Latenzzeit herstellt, das Flaggschiff-Modell „voyage-4-large“ für höchste Suchgenauigkeit, „voyage-4-lite“ für optimierte Latenzzeit und Kosten sowie ein Open-Weights-Modell „voyage-4-nano“ für die lokale Entwicklung und Tests oder Anwendungen auf Geräten.

- Erleichterte Kontextextraktion aus Videos, Bildern und Texten: Die allgemeine Verfügbarkeit des neuen Modells „voyage-multimodal-3.5“ erweitert die Unterstützung für Texte und Bilder nun auch auf Videos. Voyage AI's „voyage-multimodal-3“ war das erste Embedding-Modell, das verschachtelte Texte und Bilder verarbeiten konnte. Die neue Version „voyage-multimodal-3.5“ entwickelt diesen einheitlichen Verarbeitungsansatz weiter und vektorisiert multimodale Daten noch effektiver, um die wichtigsten semantischen Bedeutungen aus Tabellen, Grafiken, Abbildungen, Folien, PDFs und mehr bestmöglich zu erfassen. Dies hilft Entwicklern, den Aufwand für komplexe Dokumentanalysen zu vermeiden.

- Auto-Embedding für MongoDB Vector Search: Mit Voyage AI lassen sich automatisch hochpräzise Embeddings generieren und speichern, wenn Daten eingefügt, aktualisiert oder abgefragt werden. Durch die native Verarbeitung der Embedding-Generierung innerhalb der Datenbank macht MongoDB separate Embedding-Pipelines oder externe Modelldienste überflüssig. Embeddings bleiben bei Datenänderungen aktuell, die Abfrage bleibt präzise und KI-Anwendungen behalten einen zuverlässigen Kontext bei. Das Ergebnis ist eine einfachere Architektur mit weniger beweglichen Teilen, die es Teams erleichtert, KI-fähige Anwendungen im Live-Betrieb zu erstellen und auszuführen. Auto-Embeddings ist in der öffentlichen Vorschau verfügbar und wird zum Beispiel von Javascript, Python, Java und KI-Frameworks wie LangChain und LangGraph (Python) unterstützt. Aktuell verfügbar für MongoDB Community, in Kürze auch für MongoDB Atlas.“

(1) Stand: 21. Jan. 2026

Querverweis:

Unser Beitrag > MongoDB liefert mit Version 8.2 neue Plattform zur Anwendungsmodernisierung

Unser Beitrag > Zentrale Verwaltungsoberfläche für Graphdatenbanken mit Neo4j Fleet Manager

Unser Beitrag > WEKA KI-Storage macht Augmented Memory Grid auf NeuralMesh verfügbar