Produktive KI und das Problem mit der Datenpipeline; laut Umfrage unter 504 Unternehmen ist die Dateninfrastruktur bei der KI-Skalierung inzwischen annähernd so relevant wie GPUs selbst…

Hintergrund

Scality (S3 Object Storage) hat im März 2026 die Ergebnisse einer (bei Freeform Dynamics) in Auftrag gegebenen unabhängigen Umfrage unter 504 IT-Entscheidern und Verantwortlichen im Datenbereich von mittelgroßen sowie großen Unternehmen bekanntgegeben. (1) Untersucht wurde darin, wie Unternehmen ihre IT-Infrastrukturen für den produktiven Einsatz von KI entwickeln und implementieren.

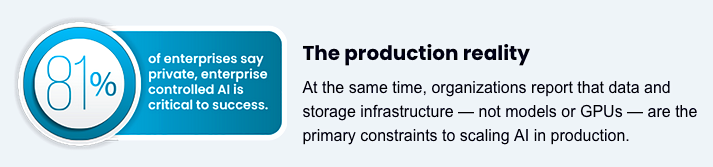

Die Studie „Storage Infrastructure for Enterprise AI: Lessons From Seasoned Adopters on Building Scalable Sovereign Environments“ soll eine zentrale Realität in Produktionsumgebungen beschreiben: „Mit dem Übergang von KI-Initiativen von experimentellen Ansätzen hin zum operativen Maßstab entwickeln sich Daten- und Speicherinfrastrukturen danach zunehmend zu kritischen Engpässen."

"Innerhalb dieser Umgebungen wird der Objektspeicher weitreichend als grundlegende Komponente von KI-Pipelines on-premise eingesetzt. Mit fortschreitender Reife von KI-Implementierungen sowie deren Übergang in den Produktionsbetrieb orientieren sich Entscheidungen in der Infrastruktur an Anforderungen wie Zuverlässigkeit, Governance, Kostenkontrolle und Lifecycle-Management.

Produktive KI ist ein Problem der Datenpipeline

Während GPUs und Rechenkapazität häufig die Diskussionen mit Blick auf KI-Infrastruktur dominieren, zeigen die Ergebnisse von Freeform Dynamics, dass Unternehmen mit Private-AI Implementierungen Systeme priorisieren, die Daten über Inferenzbasierte Pipelines hinweg bereitstellen, verwalten, schützen und wieder verwenden.

Zu den wichtigsten Ergebnissen der Studie gehören (Quelle, Anbieter):

"91 % der Unternehmen mit Private-AI Implementierungen geben an, Objektspeicher im Produktionsbetrieb aktiv zu nutzen.

44 % nutzen Objektspeicher in ihren KI-Umgebungen intensiv; 47 % davon in nennenswertem Umfang.

Damit liegt Objektspeicher leicht vor datei-basierten Lösungen und deutlich vor block-based storage.

81 % der Unternehmen betrachten eine selbst kontrollierte Private-AI Infrastruktur als entscheidend für ihren Erfolg, getrieben von Anforderungen an Souveränität, Compliance und Datenlokalität.

57 % der Unternehmen priorisieren Speicher-Performance, um Engpässe in KI-Workloads zu vermeiden.

54 % achten auf die Verfügbarkeit von Compute-Ressourcen oder GPUs, 52 % auf Netzwerkbandbreite.

44 % der Unternehmen passen ihre bestehende Compute-Infrastruktur für KI an, 42 % ihre Speicherinfrastruktur.

Gleichzeitig bauen 40 % Compute-Ressourcen und 39 % Speicher gezielt neu für KI-Workloads auf.

40 % der Unternehmen nennen die Verarbeitung von Metadaten in großem Maßstab als potenziellen Engpass, und 38 % berichten über Herausforderungen beim Umgang mit gemischten Workloads."

Die Zahlen sollen unterstreichen, dass der Speicher in produktiven KI-Umgebungen inzwischen genauso kritisch gesehen wird wie die Rechenleistung selbst. Mehrstufige, hybride Architekturen stellen die Norm dar und Greenfield-Deployments bilden die Ausnahme.

Das Ergebnis verdeutlicht somit den Bedarf an Speicher-Plattformen, die sowohl hochperformante Trainings-Workloads als auch latenzarme Inferenz über den gesamten KI-Lifecycle hinweg unterstützen.

Abb. Studie (Auszug) „Storage Infrastructure for Enterprise AI: Lessons From Seasoned Adopters on Building Scalable Sovereign Environments“ (Bildquelle: Freeform Dynamics Study).

Relevanz für Teams im Bereich Infrastruktur

Die Umfrage berücksichtigt Organisationen, die KI über die Phase von Pilotprojekten hinaus bereits in produktiven, operativen Umgebungen einsetzen. Da sich der KI-Betrieb zunehmend Inferenz-getrieben darstellt, setzen Unternehmen zunehmend auf mehrstufige Architekturen, die schnelle Storage-Tiers für aktive Workloads mit skalierbaren Kapazitätsebenen für persistente und wiederverwendbare Daten kombinieren."

In diesem Modell bildet der S3-kompatible Objektspeicher die zentrale Basis, ergänzt durch File- und andere Speichertypen, die weiterhin spezifische Anforderungen einzelner Workloads abdecken. Kommentarauszug Paul Speciale, Chief Marketing Officer bei Scality: „Die Daten definieren das Problem, und die Plattform entscheidet darüber, wer skalieren kann…“.

(1) Quelle / Studie „Storage Infrastructure for Enterprise AI: Lessons From Seasoned Adopters on Building Scalable Sovereign Environments“. Freeform Dynamics Untersuchung im Auftrag von Scality).

„Die Studie basiert auf einer Umfrage unter 504 IT-Entscheidern sowie Verantwortlichen im Datenbereich in mittelgroßen und großen Unternehmen, die Private-AI bereits produktiv in operativen Umgebungen einsetzen. Die Befragten kommen aus verschiedenen Branchen, darunter Finanzdienstleistungen, professionelle Dienstleistungen, Fertigungsindustrie, Gesundheitswesen, Life Sciences, öffentliche Verwaltung sowie der Medien- und Unterhaltungssektor. Die Mehrheit der Befragten repräsentiert Organisationen mit mehr als 1.000 Mitarbeitenden in den USA, Deutschland, dem Vereinigten Königreich sowie Frankreich.“

Querverweis:

Unser Blogpost > KI-Storage-Herausforderungen: Wie kann Speicherplatz im KV-Cache beim Einsatz großer Sprachmodelle und der Vektorsuche optimiert werden?

Unser Beitrag > NVIDIA GTC Storage Update März 2026: KI-bezogene Speicherankündigungen in der Übersicht. Was ist NVIDIA Storage-Next

Unser Beitrag > KI-unterstützte kontextbezogene Datenabfragen: MongoDB erweitert Voyage AI